Žinomas mašininio mokymosi ir dirbtinio intelekto kūrėjas tvirtina, kad jo atstovaujama sritis nuklydo nuo griežto mokslinio ir inžinerinio kelio į „alchemijos“ lankas ir pateikė siūlymą, kaip grįžti į tikrąsias vėžes, rašo livescience.com.

„Google“ dirbtinio intelekto kūrėjas Ali Rahimi tvirtino, jog jo atstovaujama sritis labai smarkiai pažengė, tačiau taip pat užsiminė, kad jos raidos kelyje būta kažko „supuvusio“. Mašininio mokymosi procese kompiuteris „mokosi“ bandymų ir klaidų metodu. Bėda ta, kad mokslininkai, sukūrę ir užprogramavę tą kompiuterį, ne tik nesupranta, kaip tiksliai jų algoritmai mokosi, bet nesupranta net to, kaip veikia metodai, skirti mašininio mokymosi algoritmams kurti. Tokią nuomonę A. Rahimi pateikė dirbtinio intelekto konferencijoje.

2017 m. A. Rahimi jau skambino pavojaus varpais dėl „mistinės“ dirbtinio intelekto pusės. „Gauname pribloškiančiai įspūdingus rezultatus. Autonominiai automobiliai, atrodo, jau tučtuojau išsuks iš už kampo, dirbtinis intelektas pažymi veidus nuotraukose, transkribuoja balso skambučius, išverčia dokumentus ir rodo mums reklamas. Dirbtiniu intelektu grindžiamas milijardų dolerių vertės įmonių veikimas. Daugeliu atžvilgiu esame geresnėje pozicijoje nei buvome prieš dešimtmetį. Kai kuriais atžvilgiais mūsų pozicija pablogėjo“, – tinklaraštyje rašė inžinierius.

A. Rahimi parodė, kad daugelyje mašininio mokymosi algoritmų prikimšta tokių „prielipų“, kurios yra iš esmės bevertės, be šių prielipų algoritmai veikia geriau. O kai kurie algoritmai yra fundamentaliai neveikiantys ir rezultatus pateikia tik dėl to, kad originalusis algoritmas būna apkarstomas storu papildymų ir pataisymų sluoksniu. Iš dalies taip yra dėl to, kad dirbtinio intelekto ir mašininio mokymosi srityje daugiau ar mažiau priimtinu tapo „bandymų ir klaidų metodas“, tinklaraštyje aiškina A. Rahimi. Dėl tokios tolerancijos dirbtinio intelekto kūrėjai patys nebesupranta, kodėl vienas bandymas įveikti užduotį buvo sėkmingas, o kitas – ne. Ir baigiasi tuo, kad į realiam darbui naudojamas sistemas žmonės diegia metodus, kurių nė kiek nesuvokia.

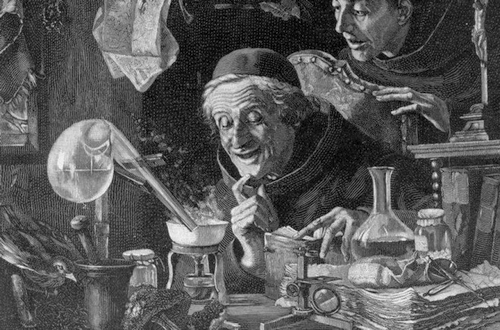

Dirbtinio intelekto tema besidomintiems žmonėms turėtų būti žinoma „juodosios dėžės“ problema: dirbtinio intelekto programos yra linkusios joms pateiktas užduotis spręsti tokiais būdais, kurie programos kūrėjams žmonėms nėra suprantami. Tačiau A. Rahimi apibrėžta bėda yra visai kitokia: mokslininkai ne tik nesupranta, kokiais būdais dirbtinis intelektas sprendžia pateiktas užduotis. Jie nesupranta net metodų, panaudotų kuriant tas programas. Kitaip tariant, anot A. Rahimi, visa dirbtinio intelekto ir mašininio mokymosi sritis yra labiau panaši į alchemiją nei į šiuolaikišką tyrimų sistemą. Nors, žinoma, alchemija mokslo istorijoje taip pat atliko savo kai kuriais atžvilgiais visai teigiamą užduotį.

„Alchemikai išvystė metalurgija, kūrė vaistų gamybos metodus, audinių dažymo būdus ir ištobulino šiuolaikinį stiklo gamybos procesą. Kita vertus, alchemikai tikėjo, kad dažnai randamus metalus galima paversti auksu, o dėlės yra puiki priemonė ligoms gydyti“, – sakė A. Rahimi. Tarptautinėje mokymosi išraiškų konferencijoje Vankuveryje A. Rahimi su kolegomis pasiūlė kelis metodus ir protokolus, kurie galėtų padėti mašininiam mokymuisi pakilti virš alchemijos lygio. Tarp jų – naujų algoritmų vertinimas pagal komponentus, atskirų komponentų šalinimas ir tikrinimas, ar visa programa vis dar veikia bei paprasčiausi „sveiko proto testai“ algoritmų pateikiamiems rezultatams.

Apsivalyti dirbtinio intelekto srityje jis siūlo dėl to, kad, kaip 2017 savo tinklaraštyje aiškino „Google“ specialistas, dirbtinis intelektas jau dabar visuomenei yra per daug svarbus, kad būtų kuriamas „kaip papuola“. „Jeigu kuriate nuotraukų dalijimosi paslaugą, tiks ir alchemija. Bet dabar juk kuriame ir sistemas, kurios valdo sveikatos apsaugą, ir mūsų pilietines teises. Norėčiau gyveni pasaulyje, kuriame sistemos yra sukurtos patikrintų, patikimų, verifikuojamų žinių, o ne alchemijos pagrindais“, – sakė jis.

Žinomas mašininio mokymosi ir dirbtinio intelekto kūrėjas tvirtina, kad jo atstovaujama sritis nuklydo nuo griežto mokslinio ir inžinerinio kelio į „alchemijos“ lankas ir pateikė siūlymą, kaip grįžti į tikrąsias vėžes.

Žinomas mašininio mokymosi ir dirbtinio intelekto kūrėjas tvirtina, kad jo atstovaujama sritis nuklydo nuo griežto mokslinio ir inžinerinio kelio į „alchemijos“ lankas ir pateikė siūlymą, kaip grįžti į tikrąsias vėžes.