Prieš kelias savaites „Open AI“ pristatė neuroninį tinklą „Sora“, galintį iš tekstinio aprašymo sukurti tikrovišką 1920 × 1080 pikselių raiškos minutės vaizdo įrašą.

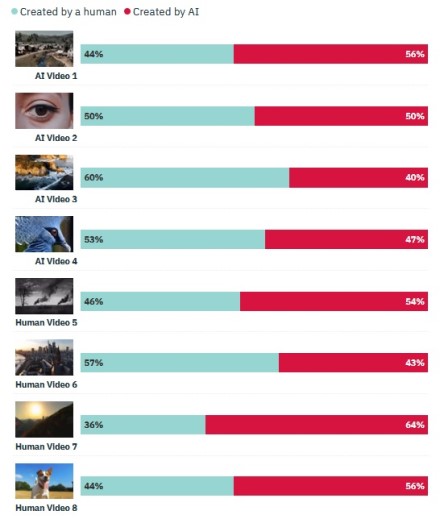

Dabar „HarrisX“ atliko apklausą, kurioje suaugusių amerikiečių buvo prašoma atskirti dirbtinio intelekto sukurtą vaizdo įrašą nuo tikro. Paaiškėjo, kad dauguma apklausoje dalyvavusių respondentų suklydo 5 iš 8 vaizdo įrašų.

variety.com nuotr.

Kovo 1-4 d. JAV vykusioje apklausoje dalyvavo daugiau kaip 1 000 amerikiečių. Tyrimo autoriai, naudodami „Sora“ neuroninį tinklą, sukūrė keturis aukštos kokybės vaizdo įrašus ir atrinko keturis nedidelius vaizdo įrašus, kurie buvo nufilmuoti realiame pasaulyje.

Respondentams šie vaizdo įrašai buvo rodomi atsitiktine tvarka, o jų tikslas buvo nustatyti, ar vaizdo įrašą nufilmavo žmogus, ar sukūrė dirbtinis intelektas. Apklausos dalyvių nuomonės išsiskyrė, tačiau dauguma respondentų 5 iš 8 atvejų atsakė neteisingai.

Šis tyrimas rodo, kad generatyvinių neuroninių tinklų pagalba sukurtas turinys tampa vis tikroviškesnis ir jį vis sunkiau atskirti nuo tikro. Todėl įvairiose šalyse vis dažniau pasigirsta raginimų valdžios institucijoms šį segmentą reglamentuoti įstatymais.

Be kita ko, siūloma įpareigoti neuroninių tinklų naudotojus tinkamai žymėti sukurtą turinį, kad jis neklaidintų kitų ir negalėtų tapti dezinformacijos šaltiniu.

„Sora“ algoritmas dar nėra prieinamas plačiajai visuomenei, tačiau jis jau kelia didelį susirūpinimą visuomenėje, ypač pramogų pramonėje, kur vaizdo generavimo technologijų plėtra turi daug neigiamų pasekmių, pavyzdžiui, kino studijoms.

Be to, vis dažniau keliamas klausimas, kad tokie „Sora“ algoritmai gali būti naudojami kuriant netikrus politikų ir įžymybių vaizdo įrašus, o tai gali sukelti pačių nenuspėjamiausių pasekmių.